Đánh Giá Undress AI: Hướng Dẫn An Toàn Cho Các Bậc Phụ Huynh Quan Tâm

Với sự phát triển của trí tuệ nhân tạo, công nghệ AI lột đồ (Undress AI) ngày càng xuất hiện nhiều hơn. Do tính chất nhạy cảm, ngày càng nhiều người lo ngại về các rủi ro mà nó mang lại.

Bài viết này là hướng dẫn an toàn khách quan dành cho phụ huynh và người giám hộ. Chúng tôi tập trung phân tích các rủi ro về quyền riêng tư và pháp lý của Undress AI nhằm giúp bảo vệ trẻ vị thành niên. Bài viết không quảng bá hoặc cung cấp đường dẫn truy cập các công cụ này.

Phần 1. Câu Trả Lời Nhanh

Undress AI hoàn toàn không an toàn cho trẻ em. Các công cụ này có thể bị lợi dụng để tạo ra hình ảnh nhạy cảm không có sự đồng thuận, bao gồm cả lạm dụng trẻ vị thành niên, kéo theo nhiều rủi ro nghiêm trọng về quyền riêng tư, tâm lý và pháp lý.

Đối với phụ huynh, điều quan trọng không phải là "cách công cụ hoạt động" mà là làm sao để phòng tránh, nhận biết dấu hiệu cảnh báo, lưu giữ bằng chứng và phản ứng kịp thời nếu trẻ trở thành mục tiêu.

Phụ huynh cần lưu ý:

- Các công cụ này có thể bị dùng để bắt nạt, tống tiền hoặc khai thác tình dục.

- Nội dung liên quan đến trẻ vị thành niên có thể vi phạm pháp luật và gây tổn hại nghiêm trọng.

- Công cụ báo cáo và gỡ bỏ rất quan trọng, nhưng phòng ngừa và phát hiện sớm còn quan trọng hơn.

- Bảo vệ ở cấp độ thiết bị giúp giảm nguy cơ tiếp xúc và cảnh báo sớm cho phụ huynh.

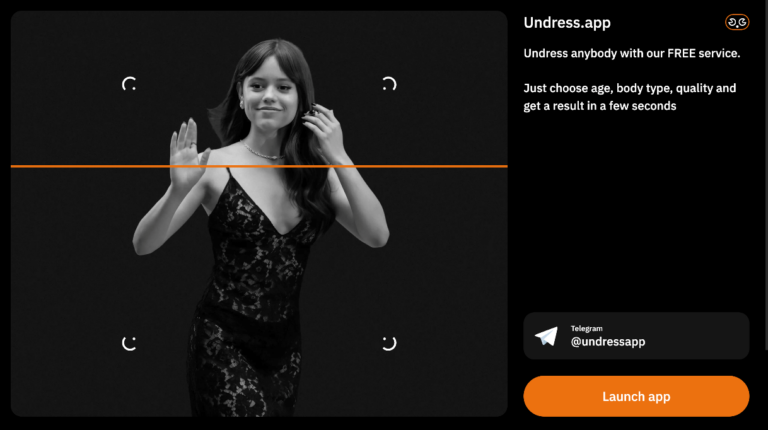

Phần 2. Undress AI Là Gì

Với công nghệ deep nude dựa trên trí tuệ nhân tạo, Undress AI là công cụ chỉnh sửa ảnh nhằm mô phỏng việc lột đồ kỹ thuật số. Chương trình này sử dụng mạng nơ-ron tích chập (CNNs) để xử lý và thay đổi hình ảnh một cách chính xác.

Hiện nay, Undress AI chủ yếu được dùng để xóa quần áo trên ảnh người. Tùy theo nhu cầu, người dùng có thể tạo ra ảnh với ngoại hình hoặc trang phục khác nhau. Chỉ với một bức ảnh bình thường (như ảnh đăng mạng xã hội), công cụ này dễ dàng biến thành ảnh khỏa thân hoặc mang tính chất khiêu dâm.

Nghiên cứu chỉ ra rằng 99% nạn nhân của Undress AI là phụ nữ, bao gồm cả trẻ em gái. Phần lớn các trường hợp, ảnh hoặc video bị sử dụng để bắt nạt, ép buộc hoặc tống tiền nạn nhân.

Đáng lo ngại hơn, báo cáo của Internet Watch Foundation phát hiện hơn 11.000 hình ảnh trẻ em do AI tạo ra có dấu hiệu phạm tội trên một diễn đàn dark web chuyên phát tán tài liệu lạm dụng tình dục trẻ em (CSAM).

Phần 3. Những Mối Nguy Tiềm Ẩn

Dù công nghệ này thể hiện sự tiến bộ của AI trong xử lý hình ảnh, nó lại đặt ra nhiều vấn đề nghiêm trọng về đạo đức và quyền riêng tư.

Theo các báo cáo từ Graphika và IWF, Undress AI không còn là vấn đề nhỏ lẻ. Năm 2025, các trang web liên quan đến "nudify" ghi nhận hơn 24 triệu lượt truy cập chỉ trong một tháng, và nội dung khiêu dâm do AI tạo ra tăng hơn 2.000%. Đây không chỉ là con số, mà là hàng triệu trường hợp xâm phạm quyền riêng tư nhắm vào người thật.

Internet Watch Foundation còn ghi nhận nhiều trường hợp ảnh AI tạo ra có liên quan đến nạn nhân thật và trẻ vị thành niên nổi tiếng. Nội dung độc hại này tiếp tục lan rộng, khiến phụ huynh trên toàn thế giới ngày càng lo lắng.

Tài Liệu Lạm Dụng Tình Dục Trẻ Em (CSAM)

CSAM là thuật ngữ chỉ nội dung khiêu dâm liên quan đến trẻ em. Một số người có thể tải ảnh trẻ em lên Undress AI để tạo ảnh khỏa thân. Hành động này bị coi là tạo CSAM. Nếu không có sự đồng ý của nạn nhân, việc phát tán các ảnh này là phạm pháp.

Việc lạm dụng như vậy không chỉ vi phạm pháp luật ở nhiều quốc gia mà còn gây tổn thương nghiêm trọng. Khả năng chỉnh sửa ảnh chính xác của công nghệ này làm dấy lên lo ngại về nguy cơ bị lạm dụng để sản xuất nội dung độc hại.

Tổn Thương Tâm Lý và Danh Tiếng

Hãy tưởng tượng: nếu ai đó đăng và chia sẻ ảnh lột đồ của bạn lên mạng xã hội hoặc các trang web khác, điều này sẽ gây ra hậu quả nghiêm trọng! Một số người xấu còn dùng các ảnh này để đe dọa hoặc bôi nhọ bạn, dẫn đến tổn thương tâm lý và ảnh hưởng danh tiếng nặng nề.

Ví dụ, một báo cáo gần đây cho biết một nữ sinh 15 tuổi là nạn nhân của công nghệ deepnude khi ảnh khỏa thân của em bị bạn học chia sẻ trên Snapchat, khiến em bị sang chấn tâm lý.

Vấn Đề Đạo Đức và Quyền Riêng Tư

Việc sử dụng Undress AI để xóa quần áo trên ảnh đặt ra nhiều câu hỏi về đạo đức và quyền riêng tư. Dù công cụ này có cảnh báo yêu cầu người dùng xin phép đối tượng, nhưng thực tế có mấy ai làm điều đó?

Xâm phạm quyền riêng tư xảy ra khi người không liên quan có thể tiếp cận các ảnh đã chỉnh sửa. Điều này đi ngược lại chuẩn mực xã hội và đạo đức, làm dấy lên lo ngại về việc lạm dụng và chia sẻ trái phép thông tin nhạy cảm.

Vấn Đề Pháp Lý

Undress AI có phạm pháp không? Việc sử dụng Undress AI để tạo hoặc chia sẻ ảnh đã chỉnh sửa có thể vi phạm nhiều quy định pháp luật, bao gồm luật về sử dụng hình ảnh cá nhân và nội dung khiêu dâm.

Tại Anh, việc tạo ảnh deepfake khiêu dâm đã bị coi là tội phạm. Người vi phạm có thể bị phạt tù nếu ảnh bị phát tán rộng rãi.

Nhiều đối tượng còn thu lợi bất chính từ hoạt động này. Các báo cáo truyền thông cho thấy tội phạm sử dụng nội dung giả để kiếm hàng triệu đô la. Quá trình tạo ảnh này quá dễ dàng, khiến nội dung độc hại lan rộng và gây tổn hại nghiêm trọng cho nạn nhân. Vì vậy, cần có các biện pháp phòng ngừa hiệu quả.

Phần 4. Phản Ứng Tại Mỹ: Nhà Cung Cấp và Chính Sách

Tháng 5/2025, chính phủ Mỹ chuyển từ giám sát tự nguyện sang thực thi pháp luật bắt buộc với việc ban hành Đạo Luật Take It Down (S.146). Luật liên bang này chính thức hình sự hóa việc đăng tải và phát tán Hình Ảnh Nhạy Cảm Do Máy Tính Tạo Ra (CGII), đặc biệt nhắm vào làn sóng deepfake AI không có sự đồng thuận.

Việc ban hành tiêu chuẩn liên bang thống nhất giúp loại bỏ tình trạng "chắp vá" luật giữa các bang, đồng thời tạo điều kiện cho nạn nhân dễ dàng tìm kiếm công lý.

Trách Nhiệm Mới Cho Nền Tảng và Nhà Cung Cấp

Điểm cốt lõi của Đạo Luật Take It Down là quy định gỡ bỏ trong vòng 48 giờ. Lần đầu tiên, các nhà cung cấp dịch vụ internet và nền tảng mạng xã hội buộc phải xử lý trong vòng hai ngày kể từ khi nhận được thông báo từ nạn nhân.

Chính sách yêu cầu nền tảng không chỉ xóa liên kết mà còn phải nỗ lực tìm và xóa toàn bộ nội dung lạm dụng tình dục do AI tạo ra trên hệ thống của mình.

Thực Thi và Tuân Thủ

Ủy Ban Thương Mại Liên Bang (FTC) chịu trách nhiệm giám sát việc thực thi quy định mới về an toàn trực tuyến này. Luật quy định nếu nền tảng không tuân thủ yêu cầu gỡ bỏ sẽ bị coi là "hành vi không công bằng hoặc lừa đảo" và phải chịu hậu quả pháp lý nghiêm trọng. Luật liên bang về deepfake bao gồm các điểm chính sau:

- Chế Tài Hình Sự: Truy tố trực tiếp người tạo và phát tán, tăng nặng hình phạt nếu liên quan đến trẻ vị thành niên.

- Thời Gian Chuyển Đổi: Các công ty công nghệ có một năm để tự động hóa hệ thống phát hiện và gỡ bỏ theo yêu cầu liên bang.

- Phòng Ngừa Chủ Động: Chuyển từ kiểm duyệt bị động sang chủ động ngăn chặn khai thác số hóa.

Việc luật hóa các quy định này buộc các nhà cung cấp công nghệ phải có trách nhiệm giảm thiểu tác hại thực tế của khai thác số hóa.

Phần 5. Bảo Vệ Trẻ: Hướng Dẫn Toàn Diện

Đánh Giá: Trẻ Có Đang Gặp Nguy Hiểm?

Phụ huynh cần đánh giá nguy cơ dựa trên hoạt động trực tuyến và các yếu tố rủi ro liên quan đến giới tính của trẻ. Đầu tiên, hãy xem trẻ thường xuyên sử dụng nền tảng nào; các ứng dụng chat ẩn danh và diễn đàn không kiểm duyệt là môi trường có nguy cơ cao bị khai thác bởi AI.

Công nghệ này có thể nhắm vào từng nhóm đối tượng cụ thể, bởi nghiên cứu cho thấy 99% nạn nhân deepfake không đồng thuận là phụ nữ và trẻ em gái. Nếu bạn có con gái, hãy chủ động trò chuyện cởi mở về Undress AI để tăng cường bảo vệ.

Phòng Ngừa: Làm Sao Để An Toàn?

Hầu hết trẻ em đều truy cập internet, vì vậy nhận thức về rủi ro mạng là kỹ năng thiết yếu. Trẻ cần biết cách nhận diện nguy cơ, không dễ bị lừa đảo hoặc tống tiền.

Phụ huynh nên dạy trẻ cách báo cáo và từ chối nội dung không phù hợp, giữ bình tĩnh khi gặp tình huống xấu, và biết khi nào cần nhờ sự giúp đỡ từ cha mẹ, người giám hộ hoặc người lớn đáng tin cậy.

Nhận Biết: Dấu Hiệu Cảnh Báo

Để phát hiện các vấn đề liên quan đến "Undress AI", phụ huynh cần quan sát thường xuyên các thay đổi hành vi bất thường của trẻ.

Bên cạnh tâm trạng thất thường, hãy chú ý các dấu hiệu tài chính như trẻ đột ngột đòi tiền mà không giải thích rõ lý do—đây thường là dấu hiệu bị tống tiền hoặc đe dọa bằng deepfake.

Các dấu hiệu khác cần lưu ý gồm giấu giếm thiết bị quá mức, xóa tài khoản mạng xã hội đột ngột, hoặc lo lắng rõ rệt sau khi lên mạng.

Nếu trẻ tỏ ra lo sợ khi sử dụng internet, hoặc ngần ngại chia sẻ ảnh với bạn bè, gia đình, phụ huynh cần cảnh giác trẻ có thể đã bị tổn thương bởi nội dung AI độc hại.

Hỗ trợ kỹ thuật cũng giúp tăng cường an toàn. Phụ huynh có thể sử dụng các công cụ như AirDroid Parental Control để giám sát từ khóa rủi ro (ví dụ "undress" hoặc "nude") theo thời gian thực và chặn truy cập các trang web "nudify" hoặc ứng dụng độc hại trước khi trẻ tiếp xúc với nội dung nguy hiểm.

Xử Lý: Làm Gì Khi Gặp Khẩn Cấp?

Nếu phát hiện trẻ là nạn nhân của khai thác số hóa, cần hành động ngay lập tức theo các bước sau:

- Bước 1. Lưu Giữ Bằng Chứng (Không Xóa!)

- Chụp ảnh màn hình chất lượng cao, đảm bảo ghi lại ID tài khoản kẻ xấu, nội dung trò chuyện và đường dẫn nền tảng liên quan.

- Lưu Ý: Không xóa file gốc ngay lập tức. Theo hướng dẫn pháp lý năm 2026 của Đạo Luật Take It Down, metadata và tiêu đề tin nhắn gốc là "dấu vết số hóa" quan trọng để cơ quan chức năng truy tìm nguồn gốc AI.

- Bước 2. Kích Hoạt Quy Trình "Xóa Trong 48 Giờ"

- Gửi đơn khiếu nại chính thức đến Snapchat, X (Twitter) hoặc Instagram, trích dẫn Đạo Luật Take It Down năm 2025. Luật yêu cầu các nền tảng này phải xử lý và chặn nội dung trong vòng 48 giờ.

- Bước 3. Sử Dụng Công Nghệ Dấu Vết Số Để Chặn

- Truy cập TakeItDown.ncmec.org. Công cụ này do NCMEC quản lý, tạo ra "dấu vết số hóa" (hash) cho ảnh, giúp ngăn ảnh bị đăng lại trên các nền tảng mạng xã hội mà không cần phải tải ảnh thật lên.

- Bước 4. Tìm Hỗ Trợ Pháp Lý và Tâm Lý

- Báo cáo vụ việc với công an địa phương, nêu rõ S.146 (Take It Down Act) để được hỗ trợ ở cấp liên bang. Luật này tăng nặng hình phạt với nội dung liên quan đến trẻ vị thành niên. Ngoài ra, hãy liên hệ chuyên gia tâm lý có kinh nghiệm về sang chấn mạng để hỗ trợ trẻ vượt qua lo âu hoặc tổn thương tâm lý.

Trò Chuyện: Mở Lời Như Thế Nào?

Trao đổi về AI giả mạo và an ninh mạng nên dựa trên sự hỗ trợ, khuyến khích trẻ chia sẻ. Hãy dùng các câu hỏi mở như sau:

"Con ơi, gần đây mẹ/bố đọc tin thấy AI có thể làm giả ảnh của người khác. Công nghệ này thật đáng sợ. Con hoặc bạn bè có từng gặp ảnh lạ như vậy trên mạng chưa?"

"Nếu chẳng may con lỡ bấm vào hoặc bị ai đó đe dọa bằng ảnh giả này, con nhớ là hoàn toàn không phải lỗi của con. Dù chuyện gì xảy ra, bố mẹ sẽ cùng con đến công an. Hiện nay đã có luật bảo vệ chúng ta rồi."

Hãy đảm bảo trẻ biết rằng nếu có chuyện gì xảy ra, trẻ sẽ không bị trách phạt và luôn có bố mẹ đồng hành. Giao tiếp cởi mở là chìa khóa giúp trẻ mạnh dạn báo cáo quấy rối trực tuyến.

Kết Luận: Undress AI Có An Toàn Cho Trẻ Không?

Không. Undress AI tiềm ẩn rất nhiều rủi ro như nội dung khiêu dâm, nguy cơ bị quấy rối, vấn đề đạo đức và pháp lý.

Tin vui là hệ thống pháp luật toàn cầu đang ngày càng hoàn thiện.

Bên cạnh Đạo Luật Take It Down (S.146) của Mỹ, Bộ Tư pháp Anh cũng ban hành luật mới, theo đó bất kỳ ai tạo ảnh deepfake khiêu dâm mà không có sự đồng thuận của người lớn đều bị truy tố và có thể bị phạt không giới hạn.

Chính phủ Úc cũng yêu cầu các trường học báo cáo mọi vụ việc liên quan đến deepfake cho cảnh sát như tội phạm tình dục đối với trẻ em.

Trung Quốc đã ban hành nhiều quy định về AI tạo sinh nhằm giảm thiểu tác hại của nội dung deepfake không có sự đồng thuận.

Các nhà cung cấp dịch vụ trực tuyến cũng đang siết chặt quy định. Meta tuyên bố sẽ kiện nhà phát triển ứng dụng CrushAI vì cố tình vượt qua các hạn chế về quảng bá ứng dụng khỏa thân trên Facebook.

Để bảo vệ trẻ khỏi công nghệ nguy hiểm, phụ huynh nên chủ động trang bị kiến thức cho trẻ về rủi ro và sử dụng công cụ kiểm soát của phụ huynh để chặn các ứng dụng, trang web độc hại.

Để lại một trả lời.