O Que é Viés da IA? Tipos, Exemplos e Como Evitá-lo

Todos os dias, a tecnologia toma grandes decisões: quais programas vamos assistir, quais candidaturas de emprego são priorizadas ou como as escolas avaliam o desempenho dos alunos. Geralmente, acreditamos que tudo isso é neutro e justo porque, afinal, é um robô! E robôs não têm sentimentos. Mas, às vezes, o resultado parece estranho. Um grupo pode se sentir excluído, ou as conclusões simplesmente não fazem sentido.

É isso que chamamos de viés da IA. Esses vieses podem afetar a aprendizagem das crianças e adolescentes, restringir os empregos que as pessoas conseguem e determinar as informações que aparecem para cada um na internet. Como isso acontece? E, mais importante, como impedir que um sistema "inteligente" acabe, sem querer, dificultando a vida de algumas pessoas?

O que é viés da IA?

Viés da IA é quando um sistema de inteligência artificial entrega resultados injustos, favorecendo ou prejudicando uma pessoa ou um grupo. Isso geralmente acontece quando o sistema aprende com dados que refletem preconceitos humanos existentes. Em outras palavras: se o mundo tem vieses, a IA capta e, às vezes, até amplifica.

O viés em inteligência artificial pode ter efeitos de longo alcance. Sistemas com viés podem gerar resultados injustos que influenciam como nossos filhos enxergam o mundo. Vamos ver alguns tipos de viés da IA e exemplos do dia a dia.

Tipos de viés da IA

O viés da IA tem várias faces e está ligado aos dados, aos sistemas e às pessoas por trás deles. Entender esses tipos é o primeiro passo para reconhecer como o viés aparece em aplicações reais.

- Viés racial: ocorre quando sistemas refletem e reforçam opiniões negativas sobre grupos étnicos ou culturais. Na maioria das vezes, isso vem de sub-representação ou má representação nos dados usados no treinamento.

- Viés de gênero: aparece quando um algoritmo favorece um gênero em detrimento de outro. Acontece quando o sistema amplia estereótipos sociais existentes ou cria uma câmara de eco que não acolhe outros pontos de vista.

- Viés socioeconômico: é a inclinação dos algoritmos para as preferências ou comportamentos de grupos com maior poder aquisitivo, tornando o acesso e a equidade inconsistentes para pessoas de baixa renda.

- Viés etário: acontece quando há tratamento diferente entre pessoas mais velhas e mais jovens. Um grupo ganha prioridade na hora de conseguir emprego, atendimento em saúde ou serviços financeiros.

- Viés educacional: ocorre quando a IA presume medir o valor ou a capacidade de alguém pelo nível de escolaridade formal, prejudicando quem seguiu caminhos não tradicionais.

Exemplos de viés da IA na vida real

Veja a seguir alguns exemplos de como as pessoas são impactadas pela IA no mundo real.

Estudo de reconhecimento facial de Stanford (2023)

Situação: Tecnologia de reconhecimento facial usada para identificar pessoas em contextos de segurança e pela polícia.

Viés: Observou-se que os algoritmos não reconhecem com a mesma precisão rostos de pessoas asiáticas e negras. Na verdade, é entre mulheres negras que mais ocorrem erros de identificação. A IA foi treinada com conjuntos de dados em que rostos de pele clara eram predominantes.

Resultado: Um erro de identificação pode levar a prisões indevidas, suspeitas infundadas ou tratamento desigual pela polícia.

Lição: Sem supervisão cuidadosa e diversidade nos dados, essas tecnologias podem perpetuar desigualdades com base em raça e gênero. Isso é um problema ético e social sério.

Viés de gênero em imagens geradas por IA (2023)

Situação: Imagens geradas por IA para representar profissionais em ciência, tecnologia, engenharia e matemática (STEM).

Viés: 75% a 100% mostram homens em áreas de STEM. Isso revela a crença de que esses empregos são majoritariamente masculinos. A IA aprende com dados passados, que muitas vezes mostram mais homens do que mulheres como especialistas. Mesmo quando mulheres têm as mesmas competências, a IA mantém a visão antiga de que homens são a maioria nessas áreas.

Resultado: Esse viés visual reforça a ideia de que homens dominam STEM, o que pode desencorajar mulheres a se candidatarem a vagas em engenharia, ciência ou matemática e manter as desigualdades de gênero.

Lição: Sem supervisão atenta, diversidade de pontos de vista na criação e avaliação contínua, sistemas de IA podem, sem querer, reforçar estereótipos em vez de promover justiça.

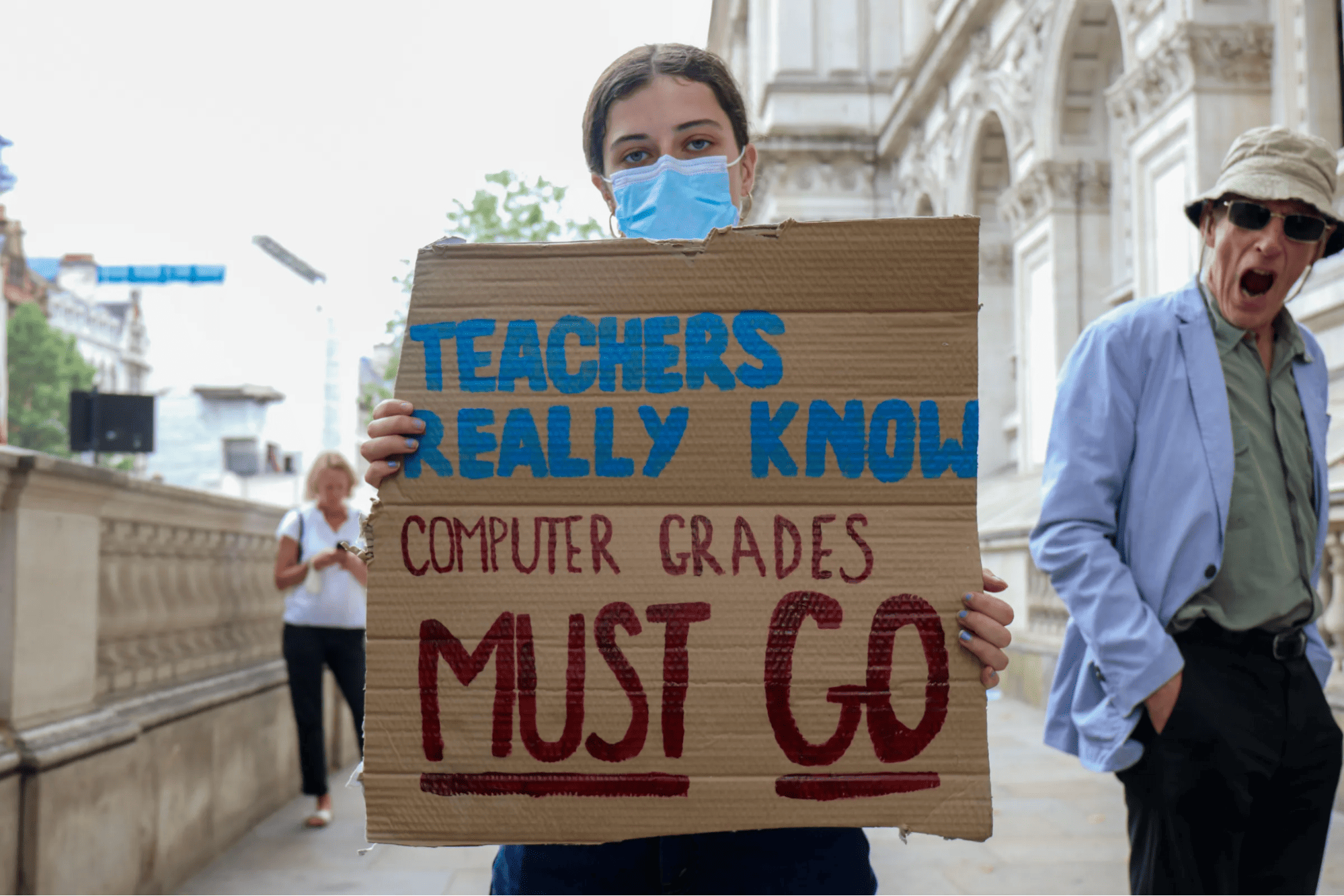

Algoritmo de A-Level do Reino Unido (2020)

Situação: O Reino Unido usou um algoritmo para atribuir notas dos exames A‑Level (exames do ensino médio britânico) porque as provas presenciais foram canceladas durante a pandemia.

Viés: O algoritmo baseou suas decisões principalmente no desempenho histórico das escolas. Escolas de áreas de baixa renda foram mais penalizadas, já que seus alunos haviam tido notas mais baixas no passado. O fato de alguns estudantes terem estudado muito e se saído bem não pesou.

Resultado: As notas ficaram abaixo do que muitos alunos dedicados realmente mereciam, afetando o ingresso na universidade e seus futuros.

Lição: Isso ilustra o viés algorítmico; a dependência de dados anteriores destaca desigualdades já existentes em vez de oferecer avaliações justas. Supervisão humana é parte da justiça quando se decide sobre o futuro das pessoas.

Maneiras simples de identificar e reduzir viés da IA no dia a dia

Sistemas de IA às vezes tratam as pessoas de forma diferente — e identificar cedo esses padrões injustos ajuda a proteger seus filhos e sua família. Você não precisa ser técnico: 4 hábitos simples já ajudam a notar o viés e agir.

1 Pergunte: isso é justo para todo mundo?

Sempre que um app ou ferramenta toma uma decisão, não aceite de cara; pense se é justa. Uma pessoa de outra idade, gênero ou cor de pele teria o mesmo resultado?

Se a resposta for não, vale investigar. Por exemplo, se um site de vagas sempre mostra salários maiores para homens, cabe questionar — as mulheres têm chance igual de acessar essas oportunidades aqui?

2 Não foque só em um erro isolado

Um resultado incorreto pode ser ruído. Mas o mesmo desfecho injusto se repetindo várias vezes provavelmente é sinal de viés. Por exemplo, se um certo tipo de foto é sempre classificado de forma incorreta em peles mais escuras, é um padrão que merece ser reportado.

3 Faça testes simples em casa para detectar viés

Muitas vezes o viés aparece quando você muda um detalhe pequeno. Ao se cadastrar num app, tente alterar nome, idade ou CEP do perfil e observe as mudanças. Se os resultados mudarem drasticamente, é um sinal de alerta. Por exemplo, crie dois perfis idênticos e troque apenas o nome feminino por um masculino. Se a lista de oportunidades diminuir, fica claro que o sistema é enviesado.

4 Observe quem é favorecido e quem fica oculto

Preste atenção a quem é incluído e quem fica de fora. Que perfis aparecem nas recomendações e quem nunca aparece? Se, por exemplo, um app de reforço escolar só destaca alunos de escolas de alto desempenho e ignora os demais, é possível perceber o viés.

Protegendo crianças dos riscos ocultos online

A inteligência artificial não está só no trabalho. Ela também molda o conteúdo que crianças e adolescentes veem na internet. Algoritmos enviesados podem influenciar os tipos de vídeos, jogos e posts que aparecem, reforçando estereótipos de forma sutil ou expondo a conteúdos inadequados. Esse risco muitas vezes fica oculto dos pais e responsáveis, que se preocupam, mas não sabem como monitorar ou orientar a experiência digital dos filhos com eficácia.

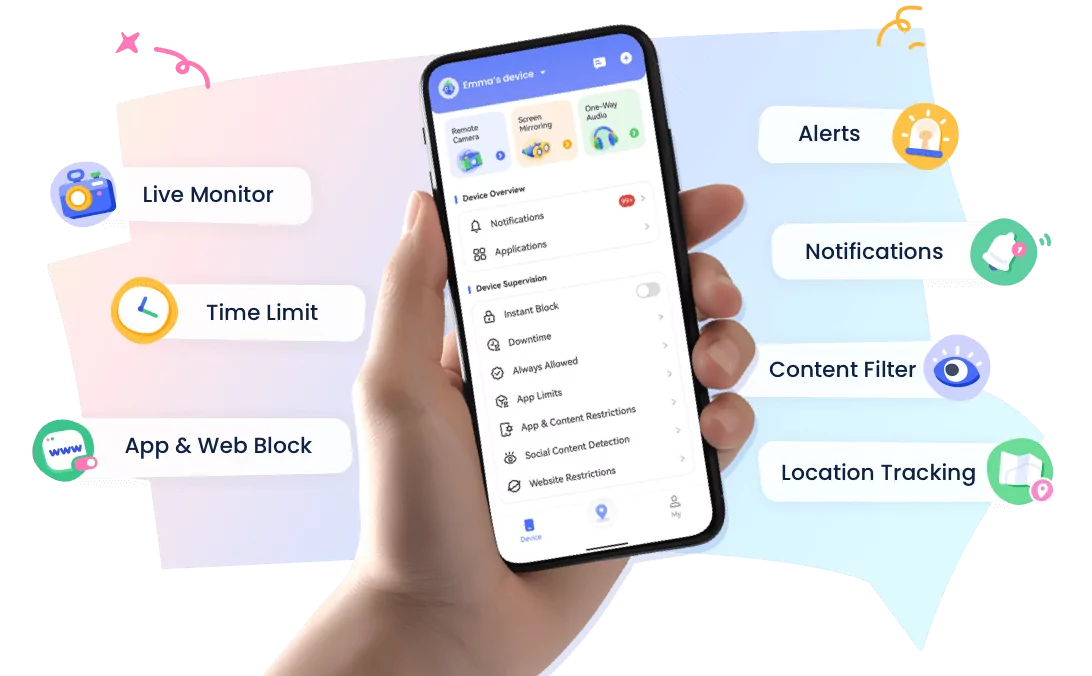

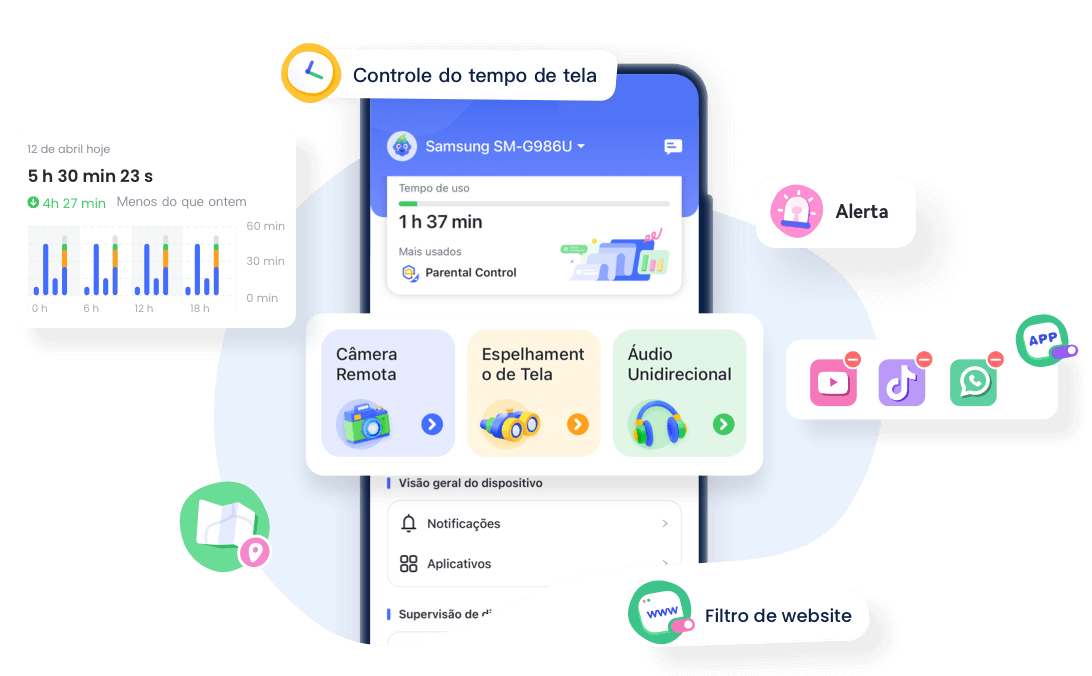

O AirDroid Parental Control é a resposta para os seus problemas. Com a ajuda do app, as famílias têm ferramentas para criar um ambiente online mais seguro e, ao mesmo tempo, incentivar o uso responsável do dispositivo. Principais recursos:

- Monitoramento de tela em tempo real: Veja quais apps e sites seus filhos estão usando, com o consentimento deles.

- Bloqueio de conteúdo: Permita apenas o que é apropriado, bloqueando conteúdos inadequados e/ou impróprios.

- Alertas e notificações: Você recebe um aviso no seu celular assim que termos explícitos aparecerem em chats ou pesquisas.

- Monitoramento de localização: Veja o tempo todo aonde seu filho está, sem precisar ligando para ele.

O AirDroid Parental Control não espiona seus filhos; ele atua como um aliado. Com o conhecimento e consentimento deles, o aplicativo ajuda as famílias a construir confiança enquanto ficam de olho no mundo digital.

Pense nele como um guia que orienta as crianças por apps, vídeos e sites onde a IA às vezes pode favorecer uns ou mostrar coisas inadequadas. Um pouco de acompanhamento, uma orientação leve — e a internet fica muito mais segura e positiva para todo mundo.

Conclusão

Líderes globais de tecnologia estão trabalhando para reduzir o viés na IA. Um dos objetivos é equilibrar a demografia das equipes que constroem esses sistemas. A Intel, por exemplo, busca ampliar a diversidade em funções técnicas. Mesmo que modelos totalmente livres de viés ainda não sejam viáveis, é possível buscar uma IA mais justa no dia a dia. Proteja sua família do viés da IA contando com o apoio extra do AirDroid Parental Control.

Deixar uma resposta.